L’art de la distillation : comment réduire la taille et le coût des modèles d’IA

Une révolution silencieuse dans le domaine de l’intelligence artificielle

L’intelligence artificielle (IA) a connu une croissance explosive ces dernières années, avec des modèles de plus en plus grands et puissants. Cependant, cette évolution s’accompagne de défis majeurs, notamment des coûts d’exploitation élevés et la nécessité d’une puissance de calcul toujours croissante. C’est dans ce contexte que la technique de distillation des modèles est devenue un outil précieux pour les chercheurs et les entreprises du secteur.

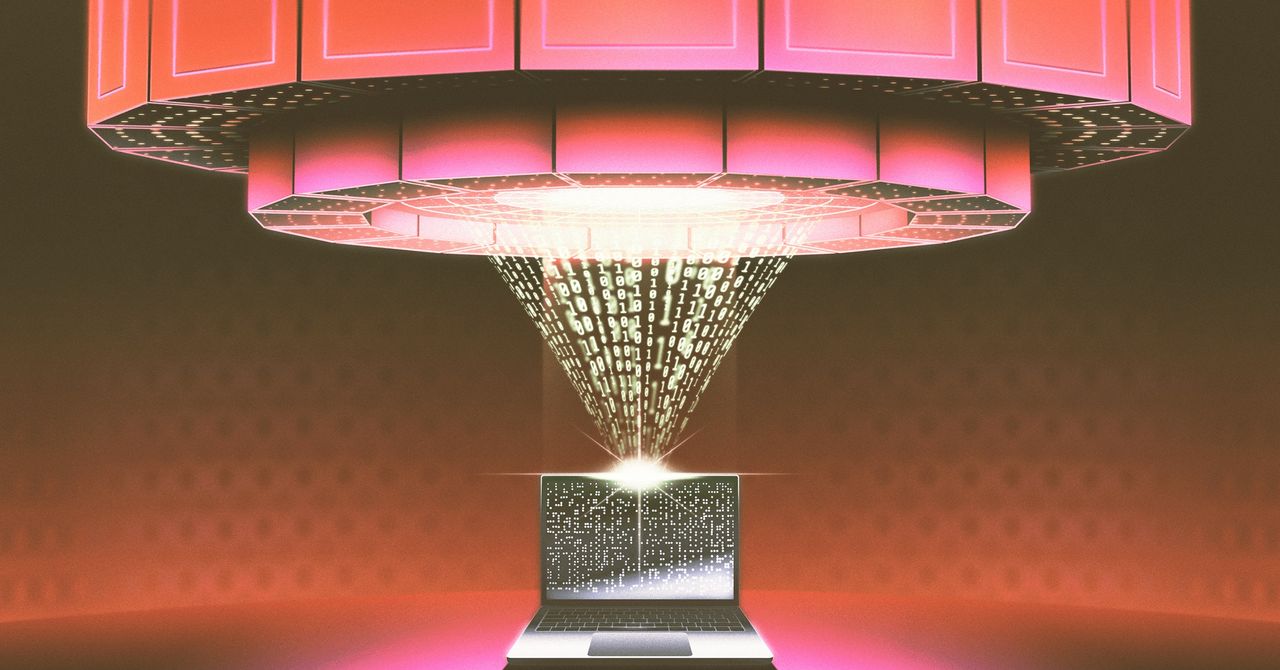

Qu’est-ce que la distillation des modèles ?

La distillation, également appelée distillation de connaissances, est une méthode qui permet de transférer les connaissances d’un modèle complexe, souvent qualifié de « modèle enseignant », vers un modèle plus simple et plus léger, connu sous le nom de « modèle élève ». Cette technique a été introduite pour la première fois dans un article de recherche publié en 2015 par des chercheurs de Google, dont Geoffrey Hinton, souvent considéré comme le père de l’IA.

Les objectifs principaux de la distillation sont les suivants :

– Réduire la taille des modèles d’IA

– Diminuer les coûts de calcul

– Maintenir une précision comparable à celle des modèles plus grands

Le principe de la distillation

Le concept de distillation repose sur l’idée que les modèles complexes contiennent des informations précieuses sur la façon dont ils prennent des décisions. Par exemple, un modèle de classification d’images peut confondre un chien avec un chat ou une pizza. La distillation permet de capter ces nuances, appelées « connaissances sombres », et de les intégrer dans un modèle plus petit.

Pour ce faire, le modèle enseignant ne se limite pas à donner des réponses fermées. Au lieu de cela, il fournit des probabilités pour chaque catégorie possible. Par exemple, le modèle enseignant peut indiquer qu’une image a 30 % de chances de représenter un chien, 20 % un chat, et ainsi de suite. Cette approche permet au modèle élève d’apprendre plus efficacement, en comprenant mieux les similitudes et les différences entre les catégories.

Applications de la distillation dans l’industrie

Depuis son introduction, la distillation a été largement adoptée dans l’industrie de l’IA. Des modèles comme BERT, qui nécessitent une grande puissance de calcul, ont donné naissance à des versions distillées comme DistilBERT, permettant une utilisation plus accessible et économique. Voici quelques applications notables de la distillation :

– Modèles de langage : des versions allégées de modèles de langage ont été créées pour faciliter l’analyse de grandes quantités de données textuelles.

– Classification d’images : des modèles distillés permettent d’effectuer des tâches de reconnaissance d’images avec une efficacité accrue et des coûts réduits.

– Raisonnement par chaîne de pensées : des modèles utilisant la distillation ont montré une capacité remarquable à résoudre des problèmes complexes en utilisant un raisonnement multistep.

Les défis et considérations éthiques

Malgré ses avantages, la distillation soulève également des questions éthiques et techniques. Par exemple, pour distiller un modèle, il faut accéder à ses « intérieurs », ce qui peut poser des problèmes de propriété intellectuelle. Les préoccupations au sujet de l’obtention non autorisée de données d’un modèle fermé, comme celui d’OpenAI, ont été soulevées dans les débats récents.

De plus, il est crucial de s’assurer que les modèles distillés ne reproduisent pas les biais présents dans les modèles d’origine. Une attention particulière doit être portée à la façon dont les données d’entraînement sont sélectionnées et à la manière dont les modèles sont évalués.

Vers un avenir plus accessible pour l’IA

La distillation offre une voie prometteuse pour rendre l’IA plus accessible, moins coûteuse et plus efficace. Alors que les coûts de formation des modèles continuent d’augmenter, les entreprises et les chercheurs peuvent tirer parti de cette technique pour développer des solutions d’IA qui répondent aux besoins croissants de la société.

En résumé, la distillation est devenue un outil fondamental dans le domaine de l’intelligence artificielle, permettant de réduire les coûts tout en maintenant une performance élevée. Alors que la recherche se poursuit et que de nouvelles applications émergent, cette technique pourrait bien transformer la manière dont nous interagissons avec l’IA.

La compréhension de la distillation et de ses implications peut non seulement enrichir nos connaissances, mais aussi nous préparer à un avenir où l’IA sera omniprésente et plus accessible que jamais.

Laisser un commentaire